15818624218

邮箱:liusyscnc@qq.com

QQ:790708208

地址:深圳市光明区光明街道碧眼社区华强创意公园5栋A座19楼

什么是姿态识别抓取?一文读懂

机器人作为面向未来的智能制造重点技术,其具有可控性强、灵活性高以及配置柔性等优势,被广泛的应用于零件加工、协同搬运、物体抓取与部件装配等领域,如图1-1所示。然而,传统机器人系统大多都是在结构化环境中,通过离线编程的方式进行单一重复作业,已经无法满足人们在生产与生活中日益提升的智能化需求。随着计算机技术与传感器技术的不断发展,我们期望构建出拥有更加灵敏的感知系统与更加智慧的决策能力的智能化机器人系统。

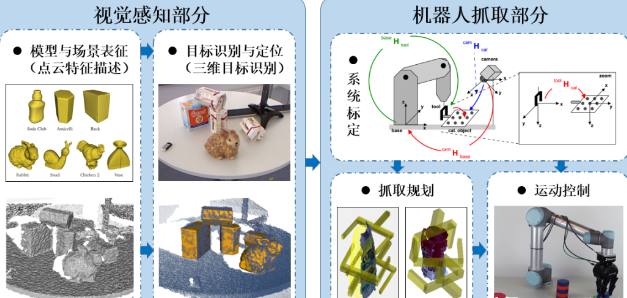

图1-2 机器人抓取的操作流程与步骤

机器人抓取与放置是智能化机器人系统的集中体现,也是生产与生活中十分重要的环节,近几年来在工业界与学术界得到了深入而广泛的研究。具体的机器人抓取可以分为视觉感知部分与机器人抓取操作部分。视觉感知部分又包含:模型与场景表征、目标识别与定位这两个步骤;而机器人抓取操作部分则包含:系统标定、运动控制与抓取规划等步骤,如图1-2所示。这其中,机器人通过视觉传感器感知环境并实现对目标物体的识别与定位,也就是视觉感知部分,是十分重要的环节,其直接决定了后续机器人的抓取精度。

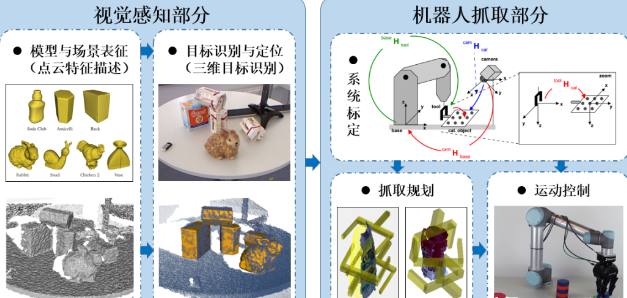

图1-3 二维图像的部分缺陷

受益于计算机算力的不断提高以及传感器成像水平的高速发展,目前针对结构化环境或者半结构化环境中,基于二维图像的机器人平面单目标物体的抓取技术已经趋于成熟,并取得了丰富的研究成果[1][2][3]。然而,对于现实复杂环境中的三维物体,仅使用二维信息对三维目标进行表征,会不可避免的造成信息损失,如图1-3所示,从而难以实现非结构化环境中机器人对于多目标物体的高精度抓取操作。因此,如何提升机器人的视觉感知能力,并基于此在复杂环境中自主完成对目标物体的识别、定位、抓取等操作是一个很有价值的研究问题。

近年来,随着低成本深度传感器(如Intel RealSense、Xtion以及Microsoft Kinect等)与激光雷达的飞速发展,如图1-4所示,三维点云的获取越来越方便。这里的点云实际上就是在相机坐标系下,对所拍摄的物体或者场景表面进行点采样。物体对应的点云数据在在数学上可以简单的理解为三维坐标的无序集合。三维点云数据相对于平面二维图像具有如下优势:(1)可以更加真实准确的表达物体的几何形状信息与空间位置姿态;(2)受光照强度变化、成像距离以及视点变化的影响较小;(3)不存在二维图像中的投影变换等问题。三维点云数据具有的以上优势使得其有望克服平面二维图像在机器人目标识别与抓取中存在的诸多不足,所以其具有很重要的研究意义以及广泛的应用前景。因此,近年来针对点云的视觉研究以及基于点云的机器人抓取成为了机器人领域新的研究热点。

图1-4 点云获取设备示意图

对应前文的,在基于点云的机器人抓取可以分为点云特征描述(模型与场景表征)、三维目标识别(目标识别与定位)与机器人抓取操作这三个部分[39][40]。进一步的,点云特征描述指的是,将模型与场景对应的无序点集通过特定的算法编码为低维的特征向量,用此来表征对象的局部或者全局信息,其应当具有足够的描述力与稳定性。三维目标识别则主要是指,利用模型与场景的表征结果,在场景中识别出目标物体,并估计出其对应的位置与姿态。对于特征描述与目标识别,尽管现有文献提出了不少算法,并且在特定的环境中取得了不错的效果,然而如何在包含噪声、干扰、遮挡与密度变化的复杂非结构化环境中提取有效而稳定的特征,实现对多目标物体的准确识别定位以及高精度抓取,仍然是极富挑战性的一个问题[4]。

综上所述,基于点云的机器人抓取作为智能化机器人系统的集中体现,近几年来得到了工业界和学术界的广泛关注,并围绕点云特征描述、三维目标识别与机器人抓取操作这三个方面展开了深入研究。具体的,在点云特征描述部分,主要关注描述子的鉴别力、鲁棒性、计算效率与紧凑性等性能;在三维目标识别部分,主要关注目标的识别准确率与定位精度问题;而在机器人抓取操作部分,抓取系统的参数标定与多目标物体的数据分析都是很重要的环节。

什么是姿态识别抓取?

基于点云的机器人抓取主要包含视觉感知部分与机器人抓取操作部分。机器人抓取操作部分则又包括系统标定、抓取规划与运动控制。

系统标定包括主要是指对相机与机器人的标定。由于对于视觉感知部分求出的待抓取目标物体的位置与姿态均处于相机坐标系下,为了进行机器人准确抓取,需要将其坐标与姿态变换到机器人坐标系下。这里便需要将相机与机器人进行手眼标定。手眼标定主要求取相机坐标系与机器人基坐标系间的变换关系[67],主要可以分为相机在手上的标定与相机在手外的标定。此外,对于相机,使用时需要进行内参的校准,畸变系数的求取等[68][69];如果是双目立体视觉,则还包含对于双目相机的参数标定[70];如果是结构光或ToF(Time of Flight)成像的点云相机,则还要进行深度校准,以及彩色图与深度图的匹配对齐等操作[71][72][73]。对于机器人,如果是多机器人协同抓取,则组要进行多机器人基坐标系间的标定[74]。

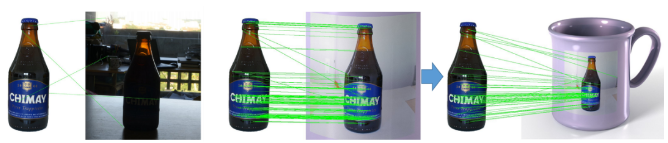

而对于抓取规划部分,其主要作用是可以实现对于场景中目标物体的抓取点的提取[75]。如论文[76]所述,抓取策略应当确保稳定性,任务的兼容性和对于新物体的适应性等;此外,抓取质量可以通过对物体接触点的位置和末端夹爪的配置来进行评价[77]。对于物体的抓取,目前主要有基于经验的方法与基于端到端的方法。

基于经验的方法则是根据特定的任务和抓取对象的几何形状,使用与之相对应的算法来进行抓取。更具体的又可以分为对已知物体的抓取和对相似物体的抓取[78]。如果抓取对象是已知的物体,那么则可以通过学习已有的成功抓取实例,再结合具体环境进行机器人抓取。事实上,如果目标对象已知,则意味着对象的三维模型和抓取点位置在数据库中也是先验已知的。这种情况下,只需要从局部视图估计目标对象的6D位姿,并通过ICP等算法进行姿态细化与精确微调,进一步便可以得到目标物体的抓取位置。这是目前已知的抓取系统中最流行的方法,也是在亚马逊抓取挑战赛[79]中普遍使用的算法。Zeng等人[79]提出了一种利用全卷积神经网络对一个场景的多个视图进行分割和标注,然后将预扫描的三维目标模型与分割结果进行匹配,得到6D目标位姿。他们的方法在2016年APC抓取挑战任务中获得了第三名和第四名。Billings和Johnson-Roberson[80]提出了一种利用卷积神经网络的管道算法,其可以同时完成目标姿态估计和抓取点选择。该管道算法作用于感兴趣区域(ROI),预测出一个中间轮廓来估计目标位姿;然后从先验的数据库中生成抓取点。对于这种方法,当有准确的三维模型是,可以通过估计出6D姿态后进行准确的抓取,由于拥有较高的抓取精度,是目前比较流行的抓取方法。然而,当三维模型不太准确时,如物体不可测量或者易变形等情况,则会导致有较大的抓取偏差。

局部抓取规划方法

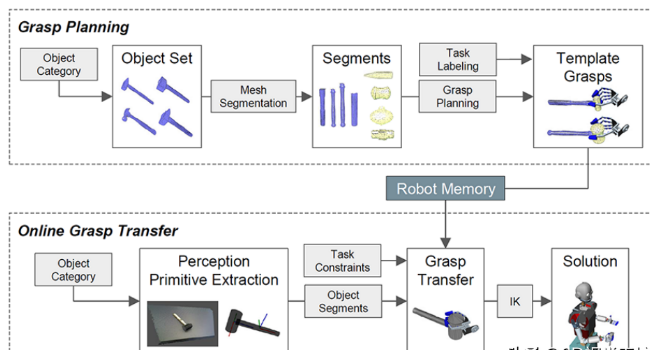

事实上,很多情况下,抓取的目标对象与现有数据库的模型并不完全相同,但是在模型库中相似的同一类的物体,这便涉及到对相近物体的抓取。在目标对象被定位以后,利用基于关键点对应算法便可以将抓取点从模型库中存在的相似三维模型上转移到当前的局部对象中。由于当前的目标对象与数据库中的对象不完全相同,所以这类型的抓取算法是不需要进行六维姿态估计的。Andrew等人[81]提出了一种基于分类法的方法,该方法将对象划分为各个类别,每个类别均存在对应的抓取规范。Vahrenkamp等人[82]提出了一种基于局部的抓取规划方法,用于生成适用于多个已知目标对象的抓取,根据物体的形状和体积信息对物体模型进行分割,并对目标零件标记语义信息和抓取信息。其还提出了一种抓取可转移性的度量方法,用于评估在同一对象类别中的新物体的抓取成功率,如图1-12所示。Tian等人[83]提出了一种将抓取构型从先前的示例对象转移到新目标上的方法,该方法假设新对象和示例对象具有相同的拓扑结构和相似的形状。他们考虑几何形状和语义形状特征对对象进行三维分割,利用主动学习算法为示例对象的每个部分计算一个抓取空间,并为新对象在模型部分和相应的抓取之间建立双射接触映射。这一类型的方法依赖于目标分割的准确性。然而,训练一个能识别出广泛对象的网络并不容易。同时,这些方法要求待抓取的三维物体与标注模型相似,以便找到相应的抓取模型。在经常发生遮挡的杂乱环境中,计算高质量的物体抓取点也是一个挑战。

不同的抓取方案示意图

端到端的抓取检测则直接跳过了对于抓取目标的定位,直接从输入的图像中提取抓取点位置。在这类方法中,滑动窗口策略是比较常用的方法。Lenz等人[84]提出了一个两步级联系统,该系统具有两个深度网络,第一步的顶部检测结果由第二步重新评估。第一个网络具有更少的特性,运行速度更快,并且可以有效地剔除不可能的候选项。第二个具有更多的特性,速度较慢,但只能在少数几个检测到的信号上运行。尽管他们达到了很高的精度,但是迭代扫描使过程非常缓慢。Ten Pas等人[85]提出了一种无需对目标物体进行精确分割即可在任何可见表面生成抓取假设的方法。他们还提出了一种新的包含表面法线和多个视图的抓取描述符。但是,由于没有执行实例级分段,因此这种算法会将多个对象视为同类物体。由于均匀网络的性能优于双级联系统[84],越来越多的单级方法被提出。Guo等人[86]提出了一种共享卷积神经网络来进行对象发现和抓取检测。Pinto和Gupta [87]提出了一种通过试错预测抓取位置的方法,他们训练了一个基于CNN的分类器来估计给定一个输入图像块的不同抓取方向的抓取可能性。Chu等人[88]提出了一个由抓取区域建议组件和机器人抓取检测组件组成的网络。对于端到端抓取检测方法,计算出的抓取点可能不是全局最优的抓取点,因为在图像中只有部分对象是可见的。

对于机器人抓取中的运动控制这一部分,其主要是设计从机械手目标物体抓取点的路径,这里面的关键问题就是运动表征。虽然从机械手到目标抓取点的轨迹是无限多的,但是由于机械臂的局限性,很多地方都无法达到。因此,轨迹需要规划。

姿态识别抓取轨迹规划主要有有三种方法,分别是传统的基于DMP的方法、基于模仿学习的方法和基于强化学习的方法,如图1-14所示。传统的方法考虑运动的动态性,生成运动原语。动态运动原语(Dynamic Movement Primitives, DMPs)[89]是最流行的运动表示形式之一,可以作为反馈控制器。DMPs对应的原语是行为单位,或者说是鲁棒的吸引子系统,其实非线性的。在算法中将运动学对应的控制策略按照规则编码为非线性微分方程组,方程组的目标就是吸引子[90]。DMPs已成功地应用于强化学习、模仿学习、以及动作识别等领域。Colome等人[91]的论文则是通过降维(线性)在学习潜在关节耦合过程的同时也进行拥有DMP特征的机器人运动,这实际上是很有价值的研究,因为这样就直接提供了这种运动的最直观的数学描述。Pervez和Lee[92]的论文提出了一个将DMP中的强迫项对应的任务参数化进行建模的数学模型。Li等[93]对应的论文则给出了一种基于高斯混合模型(GMM)和DMP的机器人强化版教学界面模型。所采集的这些动作是通过使用深度摄像头Kinect v2传感器从对应的人体演示者身上采集,采用高斯混合模型(GMM)算法进行DMPs的计算,然后对运动进行建模和泛化。Amor等[94]的论文则描述了一种基于人体动作演示的模仿学习算法,主要是用于机器人学习和运用人体的抓取技能。他们将人类的抓取动作分解为三个部分:从人的教学演示中提取有效的物体抓取策略方法,将抓取策略对应的抓取点迁移到新的待抓取物体上,对抓取动作进行优化。使用他们的方法可以很容易的在机器人中加入新的抓取类型,因为用该算法使用者只需给出一组抓取实例。

姿态识别抓取在抓取过程中,由于空间有限以及障碍物等原因,会阻碍机器人接近目标物体。这需要机器人与环境进行交互。在这种需要进行避障的抓取任务中,最常见的轨迹规划方法是以抓取对象为中心建模的算法[95],它将目标和环境分离开来。这种方法在结构化或半结构化的环境中工作得很好,因为对象被很好地分隔开了。还有一种以障碍物为中心的方法[96],它利用动作原语与多个对象进行同步联系。通过这种方法,机器人可以在接触和移动目标的同时抓住目标,以清除所需的路径。进一步的,Zeng等人[97]提出了一种更为优越的方法,其采用了无模型的深度强化学习策略来提取抓与推之间的关系。他们的方法中包含了两个卷积神经网络,行为动作与视觉感知。这两个网络是在Q-learning框架下联合训练的,完全是通过尝试和错误的自我监督,成功掌握后会获得奖励。通过仿真和真实场景下的抓取实验,他们的系统可以快速地学习复杂的行为,在存在障碍物的情况获得更高的抓取成功率和效率。

当前位置:

当前位置: